OpenAI udvikler nyt værktøj til opdagelse af AI-genereret indhold

OpenAI, firmaet bag ChatGPT, har udviklet et meget nøjagtigt værktøj, der kan opdage indhold genereret af deres AI-modeller.

Godmorgen 🤗

Der har været flere forsøg på at skabe et godt AI-værktøj, der kan opdage indhold, der er skabt af AI, og det ser ud til, at der snart kommer et godt bud.

Meta går også til Hollywood for at finde stemmer til deres kommende AI-assistenter.

God læselyst med nyhedsbrevet!

/René 🤗

Her er dagens menu:

- OpenAI udvikler nyt værktøj til opdagelse af AI-genereret indhold

- Meta indgår millionaftaler med kendte skuespillere om AI-stemmer

- Suno indrømmer brug af ophavsretligt beskyttet musik til AI-træning

- Fængsler af fremtiden: AI-genererede traumer som straf?

- Robotrevolution i tandlægestolen: Første fuldautomatiske behandling gennemført

OpenAI udvikler nyt værktøj til opdagelse af AI-genereret indhold

OpenAI, firmaet bag ChatGPT, har udviklet et meget nøjagtigt værktøj, der kan opdage indhold genereret af deres AI-modeller. Værktøjet fungerer ved hjælp af usynlige vandmærker og proprietære detektionsmetoder.

OpenAI overvejer dog ikke at frigive værktøjet til offentligheden på nuværende tidspunkt. Dette skyldes bekymringer om, at værktøjet potentielt kan omgås af ondsindede aktører.

Derudover er der frygt for, at ikke-engelsktalende brugere af AI-modeller kan blive stigmatiseret, da oversættelse af engelsk tekst til et andet sprog muligvis kan omgå detektionen.

Indtil videre findes der ingen offentligt tilgængelige værktøjer, der med høj nøjagtighed kan opdage AI-genereret indhold på tværs af forskellige opgaver. OpenAI's interne værktøj vil være det første, der benytter sig af usynlige vandmærker og skræddersyede detektionsmetoder specifikt til indhold genereret af firmaets egne modeller.

Der er endnu ingen tidsplan for, hvornår eller om OpenAI vil frigive værktøjet til offentligheden.

Meta indgår millionaftaler med kendte skuespillere om AI-stemmer

Meta, selskabet bag Facebook og Instagram, arbejder på at få kendte skuespillere og influencers som Awkwafina, Keegan-Michael Key og Judi Dench til at lægge stemme til selskabets kommende AI-assistenter.

Meta forhandler i øjeblikket med de største talentbureauer i Hollywood for at sikre sig stemmerne og er klar til at betale millioner af dollars til de medvirkende.

Stemmerne skal bruges i en digital assistentprodukt kaldet MetaAI, der vil blive præsenteret på Metas konference Meta Connect i september. Assistenterne vil være tilgængelige på tværs af Metas sociale medieplatforme, herunder Facebook, Instagram og Meta Ray-Ban smart-briller.

Kontrakterne med skuespillerne vil være midlertidige, og de kan vælge at forlænge samarbejdet, når perioden udløber. Brugen af kendte stemmer i AI-assistenter er ikke nyt, men med den seneste udvikling inden for generativ AI kan stemmerne nu efterligne rigtige mennesker på en overbevisende måde. Dette kan gøre oplevelsen mere engagerende og mindre som et billigt trick.

Meta har ikke kommenteret på historien endnu, men hvis det lykkes selskabet at få de kendte stemmer ombord, kan det blive et spændende nyt kapitel i udviklingen af AI-assistenter.

/cdn.vox-cdn.com/uploads/chorus_asset/file/23951353/STK043_VRG_Illo_N_Barclay_3_Meta.jpg)

Suno indrømmer brug af ophavsretligt beskyttet musik til AI-træning

AI-musikstartup'en Suno har indrømmet, at de trænede deres AI-model ved at bruge ophavsretligt beskyttede sange, efter at de blev sagsøgt af RIAA (Recording Industry Association of America). Suno hævder dog, at brugen af sangene er lovlig under princippet om "fair use".

RIAA sagsøgte Suno og en anden startup ved navn Udio d. 24. juni, hvor de anklagede virksomhederne for at træne deres modeller med ophavsretligt beskyttet musik.

I retsdokumenter indrømmede Suno, at deres model var trænet på "millioner af indspilninger", hvoraf nogle tilhører pladeselskaberne bag søgsmålet.

Suno's CEO, Mikey Shulman, argumenterede for, at træningen af deres AI-model på data fra det åbne internet svarer til, at "et barn skriver sine egne rocksange efter at have lyttet til genren." RIAA svarede igen ved at sige, at Sunos "industrielle krænkelse" ikke kan kvalificeres som fair use, og at Sunos vision for musikkens fremtid er en, hvor kunstnere ikke længere kan tjene penge på deres arbejde.

Sagen rejser et væsentligt spørgsmål om, hvorvidt fair use-doktrinen kan anvendes, når det kommer til træning af AI-modeller. Udfaldet af sagen vil sandsynligvis skabe en vigtig præcedens, der kan definere fremtiden for mere end blot de to startups nævnt i søgsmålet.

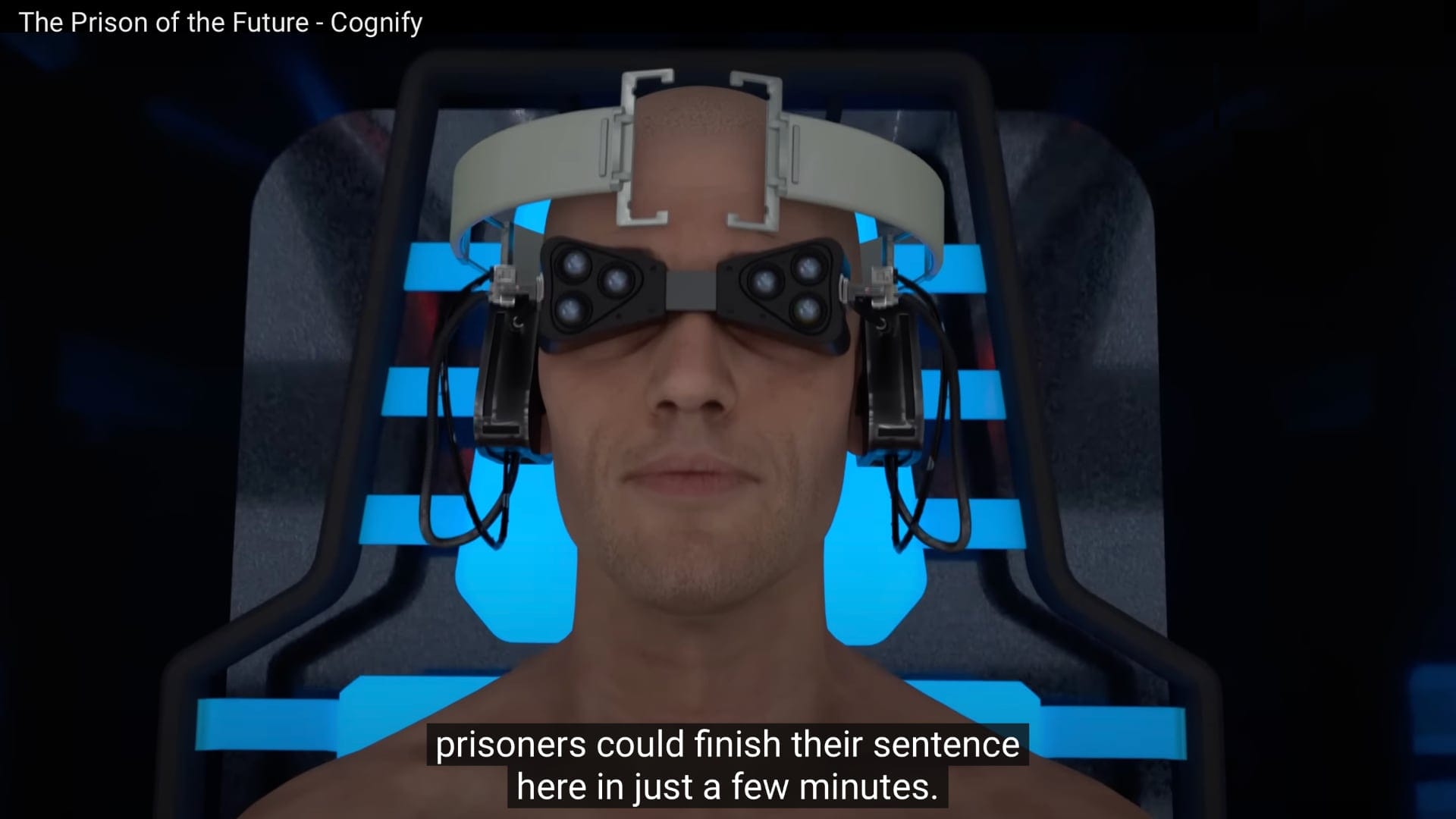

Fængsler af fremtiden: AI-genererede traumer som straf?

En kunstig intelligens ekspert har lavet en fiktiv video, der forestiller en reklame for "Cognify - Fængslet af fremtiden". I videoen foreslås det, at man i fremtiden kunne straffe kriminelle ved at indplante falske, traumatiske AI-genererede minder i deres hjerner, i stedet for at sætte dem i fængsel i lang tid.

På den måde ville de kriminelle opleve de traumer, de har påført deres ofre. Fordelene ville angiveligt være lavere udgifter til fængsler og hurtigere rehabilitering, så de kriminelle kunne komme tilbage på arbejdsmarkedet.

Selvom det lyder som urealistisk science fiction, er teknologien måske ikke helt umulig i fremtiden. Men der er etiske problemer i at skabe en falsk virkelighed i folks bevidsthed. Omvendt kan man argumentere for, at fængsling blot for straffens skyld også er uetisk og ineffektivt til at forhindre ny kriminalitet.

Forfatteren konkluderer, at det rejser svære spørgsmål om etik, sandhed og effektiv kriminalitetsbekæmpelse, som vi forhåbentlig aldrig bliver nødt til at finde svar på i virkeligheden. Det bør forblive science fiction.

Robotrevolution i tandlægestolen: Første fuldautomatiske behandling gennemført

Et fuldt automatisk tandlægerobot har for første gang udført en komplet tandbehandling på et menneske. Robotten, udviklet af firmaet Perceptive i Boston, bruger en håndholdt 3D-scanner til at danne en detaljeret model af patientens mund, tænder og tandkød.

Scanneren anvender optisk kohærens-tomografi (OCT), som kun bruger lysstråler og dermed undgår skadelig røntgenstråling.

Når scanningen er udført, kan en menneskelig tandlæge diskutere behandlingsplanen med patienten. Herefter overtager robotten hele proceduren og udfører den ca. 8 gange hurtigere end en menneskelig tandlæge. Robottens første speciale er at forberede en tand til en tandkrone - normalt en 2 timers procedure fordelt på to besøg. Robotten klarer det på ca. 15 minutter.

Selvom det kan virke skræmmende at lade en robot bore i ens tænder, er der flere potentielle fordele. Udover den markant kortere behandlingstid, behøver patienten ikke at holde munden åben lige så længe. Desuden forventes omkostningerne at falde, i takt med at robotten sparer tandlægens tid.

Perceptives robot er endnu ikke godkendt af FDA, så der går nok nogle år, før den bliver tilgængelig for offentligheden. Men firmaet arbejder på at udvide maskinens færdigheder og behandlingsmuligheder. Denne nyhed markerer en milepæl inden for tandpleje og et skridt i retning af mere automatiserede sundhedsløsninger.

Midjourney løfter billedkvaliteten til nye højder med Version 6.1

Midjourney har netop frigivet version 6.1 af deres billedgenereringsmodel. Denne opdatering bringer en række vigtige forbedringer, herunder mere sammenhængende billeder med bedre gengivelse af arme, ben, hænder, kroppe, planter og dyr.

Billedkvaliteten er markant forbedret med reducerede pixelfejl, forbedrede teksturer og hudgengivelse samt mere præcise og detaljerede små billeddetaljer som øjne, ansigter og hænder.

Nye 2x opskaleringsmodeller giver meget bedre billed- og teksturkvalitet. Standardbilledjobs er omkring 25% hurtigere. Tekstnøjagtigheden er forbedret, når der tegnes ord via "citater" i prompts.

En ny personaliseringsmodel tilbyder bedre nuancer, overraskelser og nøjagtighed. Versionsstyring af personaliseringskoder gør det muligt at bruge gamle personaliseringskoder og -data fra tidligere jobs.

Generelt skulle billeder se "mere smukke ud" på tværs af modellen. Midjourney planlægger at frigive en version 6.2 inden for den næste måned med yderligere forbedringer baseret på data indsamlet fra brugernes anvendelse af version 6.1.

Tak for at du læste med!

Jeg glæder mig til at dele flere spændende AI-nyheder med dig i næste uges nyhedsbrev. Har du tanker, spørgsmål eller bare lyst til at dele din mening? Skriv endelig tilbage - jeg elsker at høre fra mine læsere og svarer altid personligt.

Kender du andre, der er nysgerrige på AI's muligheder? Del gerne nyhedsbrevet med dem - sammen bliver vi klogere! 🤗

Vi ses på tirsdag!

Mvh. René Hjetting

Mobil: +45 29 27 65 40

Klar til at tage det næste skridt med AI?

Jeg står klar til at hjælpe dig og din, virksomhed, organisation eller netværk med at forstå og implementere kunstig intelligens på en måde, der skaber ægte værdi i hverdagen.

Lad os tale sammen, kontakt mig på:

Mobil: 29 27 65 40 eller skriv til mig her

Services

– Foredrag: Inspirerende og handlingsorienterede præsentationer om AI

– Undervisning: Dybdegående workshops og kursusforløb

– Rådgivning: Strategisk sparring om implementering af AI i jeres organisation